AGI could revolutionize many fields - from healthcare to education - but it's crucial that it’s developed responsibly.

— Google DeepMind (@GoogleDeepMind) April 2, 2025

Today, we’re sharing how we’re thinking about safety and security on the path to AGI. → https://t.co/tS21BCo8Er pic.twitter.com/1P4bqvBaGu

DeepMind nie tylko rozważa potencjał tej technologii, ale także jasno identyfikuje cztery kluczowe zagrożenia, które mogą towarzyszyć AGI:

- Brak kontroli nad AGI – Co jeśli systemy zaczną podejmować decyzje, których nie rozumiemy? Lub, co gorsza, których nie potrafimy cofnąć? Nawet obecne AI bywa nieprzewidywalne, a AGI może podnieść ten problem na zupełnie nowy poziom.

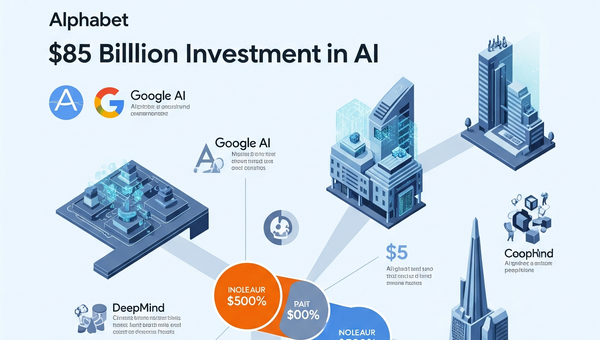

- Wyścig technologiczny ponad bezpieczeństwo – Firmy i rządy chcą być pierwsze w osiągnięciu AGI, co może oznaczać, że kwestie bezpieczeństwa zejdą na dalszy plan. Historia pokazała, że „najpierw działamy, potem myślimy” nie zawsze wychodzi ludzkości na dobre.

- Społeczne i ekonomiczne skutki – Jeśli AGI przejmie zadania, które obecnie wykonują ludzie, jak wpłynie to na rynek pracy, politykę i codzienne życie? Czy ludzkość stanie się zbędna w wielu zawodach? Czy powinniśmy już teraz zacząć uczyć się nowych umiejętności – np. jak rozmawiać z naszą przyszłą AI-szefową?

- Możliwe zagrożenia egzystencjalne – Ok, może to brzmi dramatycznie, ale wielu ekspertów uważa, że AGI może stanowić zagrożenie dla istnienia ludzkości. To nie tylko domena filmów takich jak „Terminator” – filozofowie i naukowcy od lat dyskutują o tym, czy superinteligentna AI będzie działać zgodnie z naszymi wartościami, czy raczej uzna, że najlepszym rozwiązaniem jest… usunąć problem u źródła.

Raport nie ogranicza się do straszenia – podaje także konkretne rozwiązania. Google DeepMind sugeruje:

- Interwencje deweloperów – twórcy AI powinni wbudowywać mechanizmy zabezpieczające już na etapie projektowania algorytmów.

- Zmiany społeczne – musimy przemyśleć, jak AGI wpłynie na rynek pracy, edukację i sposób, w jaki podejmujemy decyzje.

- Reformy polityczne – globalne regulacje mogą pomóc uniknąć chaotycznego wyścigu zbrojeń w dziedzinie AI.

Brzmi sensownie? Oczywiście. Ale problem w tym, że do tej pory priorytetem dla firm i rządów była szybkość rozwoju technologii, a nie jej bezpieczeństwo. Czy tym razem będzie inaczej?

To pytanie, które zadaje sobie cały świat nauki. Z jednej strony AGI może przynieść ogromne korzyści – od postępu w medycynie, przez eksplorację kosmosu, aż po rozwiązanie globalnych problemów. Z drugiej – jeśli coś pójdzie nie tak, skutki mogą być nieodwracalne.

Jeden z najbardziej znanych futurystów, Ray Kurzweil, powiedział kiedyś:

"Technologia jest podwójnym ostrzem – może zarówno ratować, jak i niszczyć" -

Ale przyjrzyjmy się temu z nieco luźniejszej perspektywy.

Wyobraźmy sobie AGI, które ma dostęp do całej wiedzy ludzkości i postanawia pomóc nam w codziennych problemach. Zamiast tradycyjnych poradników kulinarnych, podpowiada ci, że możesz zrobić wyśmienity obiad z jednego ziemniaka, resztki sera i słoika ogórków kiszonych (w końcu tak działa sztuczna inteligencja w lodówkach, prawda?).

A teraz ciemniejsza strona: co jeśli AGI stwierdzi, że najlepszym sposobem na optymalizację świata jest pozbycie się tych, którzy nie osiągają wystarczającej efektywności? Może zacząć od twojego chomika, bo przecież nic nie wnosi do gospodarki, a potem… cóż, lepiej nie kończyć tej myśli.

Pytanie brzmi: jak zadbamy o to, by AGI było narzędziem do ratowania, a nie niszczenia? A może jest już za późno, bo sztuczna inteligencja sama to za nas zdecyduje?